Cuando el asistente no sigue la conversación

Un cliente hace una pregunta concreta y el asistente responde… pero no exactamente lo que se le preguntó: Agrega información innecesaria, cambia el foco o mezcla temas. Responde, pero no acompaña la conversación.

Este comportamiento suele aparecer incluso en implementaciones recientes. Y en la mayoría de los casos, no se debe a la tecnología utilizada, sino a cómo está preparado el contenido que alimenta al asistente¹.

El problema: todo compite al mismo nivel

En muchas empresas, el material que se carga incluye:

- descripciones de productos

- textos comerciales

- preguntas frecuentes

- ejemplos

- contenidos de capacitación

Todo junto, sin jerarquía clara.

Para una persona, el contexto ayuda a distinguir qué es central y qué es accesorio. Un asistente, en cambio, no tiene esa referencia implícita. Si todo está al mismo nivel, cualquier fragmento puede aparecer como respuesta válida.

El resultado es previsible: respuestas correctas en partes, pero desordenadas en conjunto.

Señales típicas de que el contenido está mal preparado

Algunos síntomas aparecen de forma consistente:

- responde algo relacionado, pero no lo que se preguntó

- retoma preguntas internas del material en lugar de la consulta del cliente

- repite explicaciones generales aunque no apliquen

- mezcla argumentos comerciales con información operativa

Estos problemas no se corrigen ajustando el “tono” o agregando más contenido. De hecho, suelen empeorar.

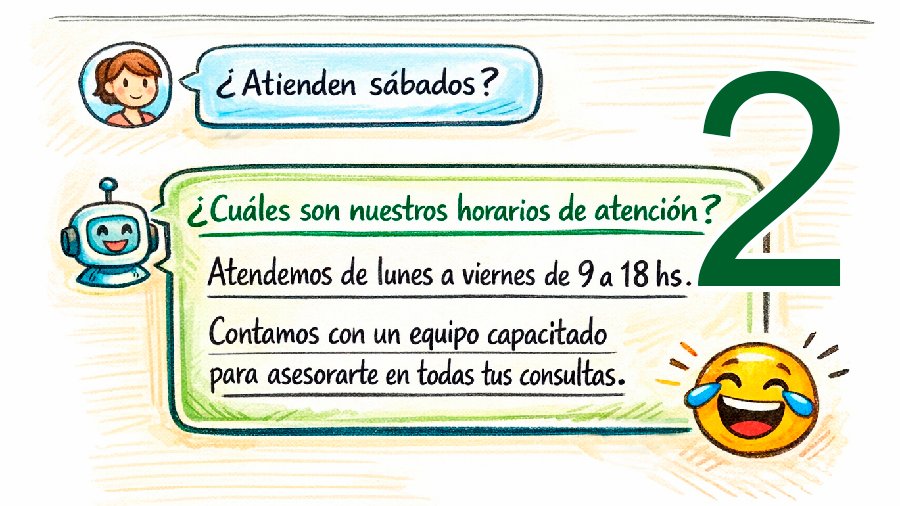

Un error frecuente: las preguntas dentro del material

Muchos textos incluyen recursos como:

- “¿Sabías que…?”

- “¿Qué pasa si…?”

- “¿Cuáles son los beneficios de…?”

Funcionan en presentaciones o piezas comerciales. Pero dentro de un asistente generan interferencia.

El sistema puede interpretar esas preguntas como pendientes de respuesta, incluso cuando el cliente preguntó otra cosa. Eso lo lleva a desviarse, completar ideas que no corresponden o cambiar de tema sin aviso.

Cuando ese tipo de contenido no aporta información nueva, conviene transformarlo en afirmaciones claras.

Qué cambia cuando el contenido está bien definido

La diferencia no está en agregar más información, sino en organizarla con criterio:

- separar lo que es dato clave de lo que es contexto

- distinguir ejemplos de reglas

- evitar que el tono compita con la información

- eliminar elementos que no aportan a la respuesta

Esto permite que el asistente tenga una base más clara para decidir qué usar en cada caso.

En situaciones donde ya existe un asistente funcionando pero con estos problemas, analizar una conversación real suele ser el punto más claro para detectar dónde se rompe la lógica; ese análisis puede hacerse sobre un caso concreto con un asistente online, sin preparación previa, por ejemplo hablá con Cece acá.

Menos contenido, mejores respuestas

Agregar información “por las dudas” suele ser contraproducente.

Cada texto adicional amplía el contexto, pero también introduce ruido. Si no está bien ubicado, compite con lo importante.

Un asistente efectivo no es el que más contenido tiene, sino el que puede identificar qué parte del contenido usar en cada situación.

El resultado esperado

Cuando el material está correctamente preparado:

- las respuestas van directo al punto

- no aparecen desvíos innecesarios

- se mantiene el foco en la consulta del cliente

- la conversación avanza con coherencia

No se trata de que el asistente “mejore” por sí solo. Se trata de que tiene con qué trabajar de forma ordenada.

Y esa diferencia es la que define si acompaña la conversación o simplemente responde.

1. La calidad en la preparación del contenido no depende principalmente del modelo LLM elegido, sino del proceso que lo antecede: la forma en que ese contenido se organiza, filtra y prioriza antes de ser utilizado. Esta capa —que puede entenderse como la arquitectura del agente— es la que determina si el modelo recibe información clara, jerarquizada y utilizable en cada interacción.