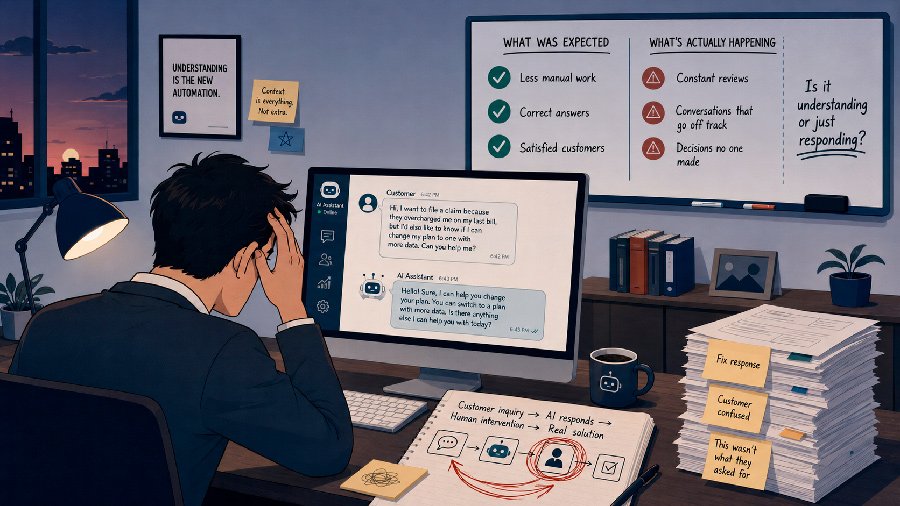

Cuando la IA está, pero no resuelve

En muchas empresas, hay herramientas de IA en uso: asistentes que responden consultas, automatizaciones en atención al cliente, generación de textos para marketing, análisis de datos. En apariencia todo está en marcha.

Sin embargo, cuando se mira más de cerca, aparece otra realidad:

- respuestas que no terminan de servir

- conversaciones que se desvían

- automatizaciones que requieren corrección constante

- decisiones que siguen dependiendo completamente de una persona

La IA está presente, pero no está resolviendo el problema que se esperaba.

El error no está en la herramienta

Una interpretación común es que el problema está en la calidad de la tecnología elegida; pero en la práctica, incluso usando herramientas caras y avanzadas, los resultados suelen ser similares. La diferencia no la hace "el modelo de LLM" en sí, el punto crítico es otro: la forma en que la empresa define el problema que espera que la IA resuelva.

Y en muchos casos, ese problema está mal planteado desde el inicio. Por ejemplo:

- Se intenta automatizar respuestas sin entender cómo se toman decisiones en esas conversaciones

- Se delegan tareas ambiguas sin definir criterios

- Se trasladan procesos humanos directamente a un sistema que no puede interpretarlos igual

La IA termina respondiendo… pero lo hace sin entender.

Donde se rompe la lógica

El quiebre suele aparecer en situaciones que, para una persona, son triviales: Un cliente hace una consulta incompleta, un mensaje mezcla varias intenciones, una respuesta correcta depende del contexto previo, etc. En estos casos, lo que se necesita no es información, sino criterio para interpretar lo que está pasando.

Cuando ese criterio no está definido, la IA llena el vacío como puede, responde lo que le parece más probable, completa supuestos que no corresponden y mantiene conversaciones que deberían haberse redirigido, entre otros intentos de respuesta.

Las consecuencias no son menores

Este tipo de fallas no siempre se detecta de inmediato y, además, tiene impacto acumulativo:

- Clientes que reciben respuestas incorrectas o confusas

- Equipos que pierden tiempo corrigiendo lo que debería estar resuelto

- Decisiones basadas en información mal interpretada

- Pérdida progresiva de confianza en el sistema

En muchos casos, la conclusión es que “la IA no funciona para este negocio”; pero lo que falló no fue la tecnología sino la forma en que se intentó usar.

El límite de la experimentación

Muchas empresas quedan atrapadas en una etapa permanente de prueba: se agregan herramientas, se ajustan prompts, se cambian configuraciones... Pero el problema de fondo no cambia: la IA sigue operando sin un marco claro para interpretar situaciones reales.

Esto suele estar ligado a una restricción estructural: no hay tiempo, ni recursos, ni claridad para definir cómo debería pensar el sistema en contextos complejos.

Entonces se avanza igual... sobre una base inestable.

Qué cambia cuando el problema está bien planteado

Cuando el foco se mueve de la herramienta al problema, aparece otro tipo de implementación, donde la diferencia no está en lo que la IA “dice” sino en cómo decide qué hacer en cada caso.

Lo cual implica:

- reconocer cuándo una consulta está incompleta

- distinguir entre una duda informativa y una decisión comercial

- priorizar contexto sobre literalidad

- saber cuándo escalar a una persona

En ese escenario, la IA deja de ser un generador de respuestas y pasa a formar parte de un sistema que interpreta situaciones. Y acá es donde empieza a tener impacto real.

Por qué esto es difícil de ver desde adentro

Uno de los obstáculos más frecuentes es que estos problemas no son evidentes desde una vista general. Desde afuera, el sistema “funciona”: responde, interactúa y hasta produce resultados; pero el desvío ocurre en el detalle: en cada caso donde la respuesta no era esa, en cada decisión que no se tomó correctamente.

Detectarlo requiere bajar a casos concretos. Por ejemplo, analizar una conversación real donde el sistema respondió mal permite ver con claridad si el problema es de información, de contexto o de criterio; ese tipo de análisis suele ser difícil de estructurar internamente y en esos casos puede tener sentido usar un espacio externo para pensar el caso, como el asistente online de ConverseCraft, haciendo clic aquí.

El cambio no es técnico, es conceptual

El salto no ocurre cuando se incorpora una nueva herramienta, ocurre cuando se redefine qué significa “resolver” un problema dentro de una conversación.

Mientras la IA se use para producir respuestas, los límites aparecen rápido. Cuando se la integra como parte de un sistema que interpreta y decide, el comportamiento cambia, lo que en la mayoría de los casos es posible incluso con los modelos más económicos porque no dependía de la tecnología sino de que el problema esté mejor entendido.

Lo que separa a los casos que funcionan

Las empresas que logran resultados sostenidos con IA no necesariamente tienen más recursos. Lo que cambia es otra cosa:

- el problema está definido en términos de decisiones, no de respuestas

- el contexto tiene más peso que la literalidad

- hay una lógica clara sobre cuándo intervenir y cuándo no

- el sistema está pensado para situaciones reales, no ideales

En este punto, la IA deja de ser un experimento y pasa a ser parte del funcionamiento del negocio. Porque el problema no es que la IA no funcione: El problema es que en muchos casos se la está usando para algo distinto de lo que realmente se necesita resolver.